El meu professor (potser) serà una Intel·ligència Artificial

25 juny, 2018

Una distinció important en el camp de l’Intel·ligència Artificial (IA) es troba entre narrow AI i general AI (Artificial General Intelligence o AGI). La primera consisteix en un programa informàtic que usa tècniques d’ IA (Machine Learning, Deep Learning) i està dissenyat per solucionar un problema específic (des de jugar a escacs a detectar vianants i obstacles pel carrer). Per contra, l’AGI es refereix a les màquines amb la capacitat de resoldre molts tipus de problemes per si soles tal com fan els humans, és a dir, podrien entendre l’entorn i raonar com un ésser humà. Doncs bé, fins ara, totes les aplicacions que hi ha d’IA són exemples de narrow AI.

Encara que l’IA general és actualment un tema de recerca, encara és probable que trigui unes dècades a ser quelcom real (cal pensar, però, que ja portem 60 anys dient que serà durant els propers 20). De moment, només trobem AGI a la literatura i les pel·lícules de ciència ficció. Tanmateix, en els últims anys s’estan produint avenços molt importants a les tècniques d’IA que permeten començar a pensar en una AGI viable, ara potser si, en, posem, un parell de dècades.

I si aquesta AGI l’apliquéssim a l’educació? Com hauria de ser un bot/assistent o AGI dedicat a l’aprenentatge? Partint del que ja es pot fer ara (amb chatbots i Machine Learning) i mentre fem aquest camí, ens anirem trobant moltes preguntes sobre l’ AGI que caldrà respondre a mesura que anem incorporant avenços al nostre model. Qui sap? potser en 20 anys el nostre professor serà una AI…

Consideracions sobre l’aspecte, la personalitat i les atribucions docents

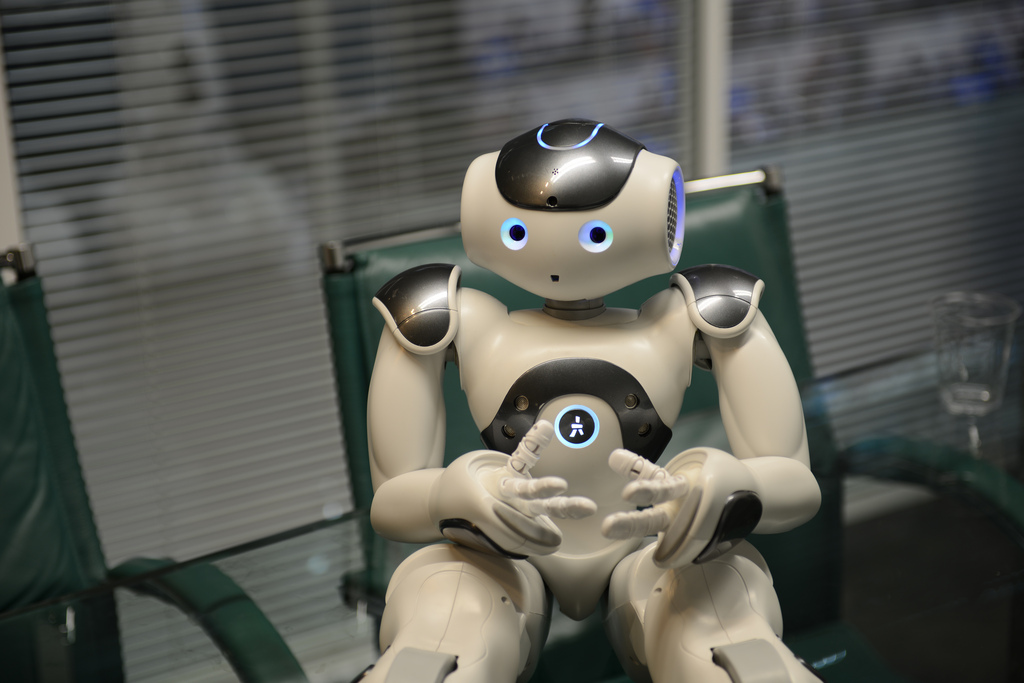

Serà molt important decidir quin grau d’antropomorfisme (tendència a considerar realitats o elements no humans com si fossin humans) volem pel nostre assistent docent. Això implica donar-li o no qualitats i característiques humanes com pot ser posar-li nom, decidir l’aspecte que tindrà en diferents canals (aspecte visual però també la veu o l’accent, si parla), si té una aparença física (robòtica) o només virtual i si cal donar-li una història prèvia. De fet, l’antropomorfisme provablement facilitaria la comunicació i l’ergonomia. També cal pensar si hi haurà un sol assistent per tothom o un particular per a cada alumne, o un de comú per a cada matèria.

Pot semblar banal, però ja ens dirigim pel nom a Siri o Alexa. De moment no ho fem (potser algú sí) al sistema de navegació del cotxe, però la frontera no està clara. Quan aquest assistent es converteixi en el nostre interlocutor i deixi de ser una simple eina, caldrà plantejar-se aquestes coses.

Serà interessant el debat sobre quin nivell d’”humanitat” li hem de donar i quina relació establirà amb l’alumne. Podrem simular moltes característiques humanes de la personalitat però caldrà veure si ho fem o no, d’entre elles, simular el sentit de l’humor, la sensibilitat, l’empatia, l’assertivitat. També es podrà detectar l’estat d’ànim de l’alumne i actuar en conseqüència. A banda d’això, també cal pensar en si tindrà consciència temporal de les sessions anteriors.

També em pregunto si el nostre professor virtual es limitarà a respondre els dubtes (i serà una eina) o serà proactiu i donarà consells de com fer els treballs, recordarà dates d’entrega i vetllarà per l’èxit de l’estudiant, serà com un “coach” docent? Potser caldrà posar límits a l’ajuda que proporciona per evitar que l’estudiant es recolzi massa en ell… Ah, i tot això serà configurable? Alguns alumnes es poden sentir millor amb un professor virtual amb una personalitat determinada o que utilitza un to determinat.

I, finalment, respecte al nivell de “saviesa” del bot, sobre quines temàtiques tindrà coneixement? només sobre les del temari oficial de la universitat o estarà obert a recursos externs (com ara la Wikipedia o altres fonts d’Internet)?

Consideracions ètiques

Consideració 1. Honestedat i transparència.

És just intentar enganyar als estudiants i no dir-los que el professor assistent és una IA, com Jill Watson, el conegut cas de Georgia Tech o com el recent exemple de Google Duplex, on la perruqueria o el restaurant, suposadament, no saben que el client és una màquina? o és preferible dir clarament que hi ha un tàndem humà-màquina? Crec que la segona opció és millor i més justa.

Consideració 2. L’antropomorfisme extrem i la “vall inquietant”

Lligat a la consideració anterior, hi ha un tema a tenir en compte. L’uncanny valley, traduït com a vall inquietant o vall inexplicable, és una hipòtesi de la robòtica que diu que quan l’aparença d’un robot és humana, la resposta emocional dels humans al robot s’anirà fent cada vegada més positiva i empàtica fins a arribar a un punt a partir del qual la resposta es torna en repugnància. Després, si aconseguim que l’aparença sigui encara més alta, tornem a nivells alts d’empatia. Es a dir, hem d’humanitzar al robot però només fins a cert punt, evitant que faci por o angunia, o, pel contrari, decidir fer-lo virtualment indistingible d’un humà.

Consideració 3. Biaix a causa d’entrenament erròni de les màquines

Les respostes docents de l’IA poden ser incorrectes perquè l’hàgim entrenat amb dades que poden ser errònies com ara respostes prèvies donades per altres estudiants (en els debats), interaccions prèvies amb l’estudiant o material no validat d’Internet. Estic convençut que l’expert humà ha d’estar present d’alguna manera en aquest procés per validar les dades d’entrenament. Hem de posar un “humà en el circuit” (de l’ anglès Human-In-The-Loop, concepte també conegut per les sigles HITL) per garantir que no hi ha biaix i que no passi com amb Tay, el chatbot de Microsoft que es va tornar racista.

Consideració 4. L’objectiu final de la màquina

Com passa amb els automòbils autònoms (que en un hipotètic cas d’accident, podrien decidir qui mor i qui no), els objectius finals (programats) de l’ IA educativa podrien ser variats i fins i tot contradictoris:

- L’objectiu podria ser que l’estudiant aprengui (i llavors correm el risc que l’AI posi activitats difícils i molt reptadores que, per altra banda, podrien causar que l’estudiant suspengui).

- O podria ser que l’estudiant aprovi (i després hi ha el perill de que l’IA faci proves massa fàcils, suggereixi les respostes i faci que passar el curs sigui massa fàcil i que l’estudiant no aprengui).

- Fins i tot l’objectiu podria ser que l’estudiant matriculi moltes assignatures (i llavors potser l’IA no doni informació realista de la capacitat de l’alumne de fer moltes assignatures i amagui potencials dificultats per passar curs).

Veiem que cada part interessada en el procés docent (docents, estudiants, màrqueting, departaments financers, societat, mercat laboral, etc.) pot tenir objectius oposats. En aquest cas, cal posar la “societat al circuit”, i fer un contracte social educatiu.

Conclusió

Potser hem d’esperar una mica per a que sigui possible tenir un assistent artificial amb totes les funcions de l’AGI desplegades però, mentrestant, pensem que val la pena començar a plantejar-se totes aquestes preguntes; algunes de les respostes ja poden ser implementades avui mateix amb l’estat actual de la tecnologia.

I, amb la mirada posada en el famós horitzó dels 20 anys, també hem de començar a pensar, com a societat, quin paper jugarà l’IA a l’educació, les implicacions que comportarà una AGI, quin és el rol que han de tenir les persones i quin el de la societat.

*(Crèdits de la foto de capçalera: Nao Robot per steveonjava a Flickr)